Il a toujours été difficile d’obtenir une cohérence dans les vidéos générées par l’IA. Si la création de modèles et de vêtements virtuels est simple, créer une vidéo dans laquelle Elon Musk modélise un manteau de fourrure reste une tâche complexe.

Le modèle 2.0 récemment mis à jour de Pika offre une solution intelligente : en téléchargeant plusieurs photos, Pika peut référencer des éléments spécifiques pour générer des vidéos avec une précision remarquable.

En fournissant des photos de personnes, de produits et de décors, les utilisateurs peuvent créer une vidéo commerciale de base où les visuels correspondent étroitement aux images originales.

Cela signifie-t-il que l’IA a résolu le problème de la cohérence vidéo, créant ainsi de nouveaux défis pour les annonceurs ? Pas tout à fait. Si Pika est amusant à utiliser, son côté pratique peut encore être amélioré.

Créer des scènes irréelles avec Pika

La fonction de saisie multi-images de Pika, appelée « Scene Ingredients », permet aux utilisateurs de combiner des photos et de générer des scénarios uniques. Voici comment cela fonctionne :

- Téléchargez jusqu'à six images en cliquant sur le bouton « + ».

- Ajoutez une invite simple dans la zone de texte.

Prenons par exemple Elon Musk et Ultraman pour regarder un film ensemble. Invite : Deux personnes sont assises dans une salle de cinéma sombre, tenant du pop-corn et se concentrant sur l'écran avec impatience…

Il suffit de télécharger leurs photos et l'environnement du théâtre est créé à partir de l'invite. Alors qu'Elon Musk semble réaliste, l'apparence d'Ultraman semble exagérée et déconnectée de la photo originale.

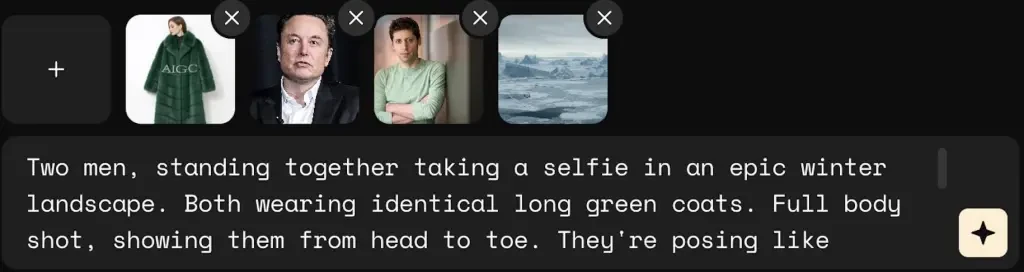

L’une des caractéristiques remarquables de Pika est sa capacité à « réutiliser » des éléments. Par exemple, nous pouvons habiller Musk et Ultraman de manteaux verts assortis et créer une séance photo de mode.

Les photos des deux personnes proviennent toutes deux d'images prêtes à l'emploi. Le manteau vert et le fond enneigé et glacé ont été générés séparément à l'aide de l'IA, le texte « AIGC » sur le manteau servant de défi à Pika.

Le résultat a montré une bonne cohérence entre la scène et le manteau, et le texte « AIGC » était à peine reconnaissable. Les poses des modèles suivaient également les instructions. Mais le plus gros problème est de savoir qui sont ces deux personnes ? Les visages dans la vidéo et sur les photos ne sont peut-être pas identiques, mais ils n’ont aucun rapport.

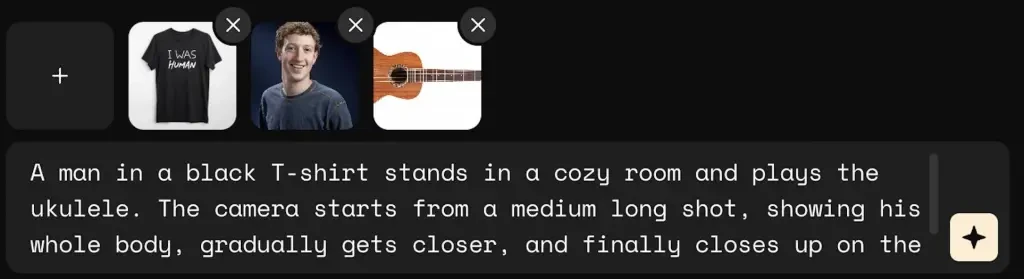

Ensuite, nous avons testé la personnalisation de la tenue de Pika en générant un T-shirt noir avec la phrase « I was human ». Nous avons ajouté une photo de Mark Zuckerberg et une photo d'un ukulélé pour créer une performance musicale.

Pika a bien suivi le message et le mouvement de la caméra était fluide. Les vêtements ont également été enfilés sans problème, mais la main droite, en particulier le pouce, n'est toujours pas parfaite.

Comparé à Google Veo et OpenAI Sora, le modèle de Pika n'est pas de premier ordre. La résolution d'un problème révèle souvent davantage d'erreurs.

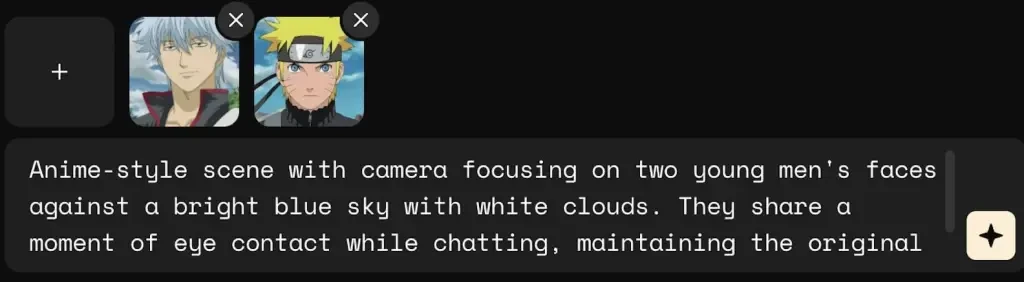

Après avoir essayé un style réaliste, passons à un style anime. Pour avoir Gintoki Sakata et Naruto Uzumaki dans le même cadre, j'ai choisi deux images avec un ciel bleu et des nuages blancs en arrière-plan.

L'arrière-plan se fond naturellement et les expressions sont bien capturées, l'effet du vent sur les cheveux et les vêtements s'adaptant parfaitement. Cependant, l'effet de rotation est assez troublant. Les yeux de Gintoki semblent sans vie, ne se révulsant pas vraiment.

Vous pouvez également faire interagir des tableaux célèbres avec différentes époques, comme la Joconde et la Jeune Fille à la perle mangeant des frites chez McDonald's. L'effet n'est pas idéal. En voyant la Joconde, on se demande si Léonard de Vinci se retournerait dans sa tombe. Les personnages ressemblent à des autocollants placés dans la vidéo, avec des mouvements de tête étranges.

Parfois, le retour à la simplicité donne des résultats inattendus. Le téléchargement d'une image de Starbucks et d'un tableau des Nymphéas de Monet donne une tasse de café « en forme de lotus ».

En concurrence avec les modèles fabriqués en Chine, le contrôle de la vidéo IA est désormais plus facile

Dans une certaine mesure, Pika a amélioré la contrôlabilité vidéo. Bien que ce ne soit pas entièrement réussi, comme on peut le voir dans la pratique, Pika maintient la cohérence dans les scènes, les vêtements et les objets, mais les visages ont tendance à se déformer quel que soit le style.

De plus, les capacités de base de Pika doivent être améliorées. Des actions comme manger ou jouer du piano posent toujours des problèmes. Ces problèmes peuvent-ils être résolus en piochant des cartes ?

En trois mots : pas abordable. Pika 2.0 est actuellement disponible uniquement pour les utilisateurs Pro et Fancy, au prix d'au moins 35 $ par mois sans essai gratuit. De plus, les utilisateurs Pro n'obtiennent que 2000 points par mois, mais l'utilisation de la fonctionnalité Scene Ingredients coûte 100 points par vidéo.

En fait, le modèle vidéo IA de fabrication chinoise Vidu a implémenté la fonction « référence multi-images » avant Pika. Plus attrayant pour les utilisateurs, il propose des points d'essai gratuits.

J'ai testé quelques cas de Pika sur Vidu. La Joconde et la jeune fille à la perle en train de manger des frites semblent tout juste sorties du sol, mais la ressemblance avec la Joconde est meilleure que celle de Pika.

Elon Musk et Ultraman regardent un film ensemble, le visage de Musk est précis à environ 70-80 %, mais le visage d'Ultraman n'est toujours pas génial.

Gintoki Sakata et Naruto Uzumaki dans le même cadre, Vidu peut générer un visage latéral à partir d'un visage de face, mais le style diffère de l'image originale.

De plus, Vidu présente une limitation par rapport à Pika : il ne peut télécharger qu'un maximum de trois images. Ainsi, lorsque j'ai utilisé Vidu pour créer une séance photo de mode pour Musk et Ultraman, j'ai uniquement téléchargé leurs photos et un manteau vert, en laissant de côté l'arrière-plan.

Les résultats ne m'ont pas semblé familiers. Il est clair que maintenir la stabilité du visage reste un défi.

En comparant Vidu et Pika, les avis peuvent varier. Pika utilise une version professionnelle, tandis que Vidu utilise une version gratuite, ce qui explique certaines différences. Cependant, l'approche de Pika et Vidu est similaire : ils utilisent seulement quelques images et des invites simples pour générer des objets relativement stables.

Dans la génération de vidéos IA, la cohérence des sujets est actuellement mieux assurée avec la solution LoRA. Cela implique d'affiner le modèle avec une certaine quantité de matériel spécifique. Avec un matériel et une formation adéquats, le modèle apprend progressivement les caractéristiques d'apparence du personnage.

Mais pour rendre les vidéos IA plus accessibles et plus intéressantes sur le plan commercial, il faut abaisser la barrière à l’entrée. Au moins avec Vidu et Pika, nous voyons le potentiel.

Devenir viral avec les vidéos courtes d'IA : un aller simple vers la créativité

Peu de temps après la sortie du modèle 2.0 de Pika, les utilisateurs internationaux s'amusaient déjà beaucoup. En générant à plusieurs reprises des vidéos dans différentes scènes à partir de leurs propres photos, ils pouvaient réaliser un « voyage instantané dans l'univers ». Grâce à l'IA, il suffit d'un clic pour essayer des vêtements. Les modèles et les tenues s'enchaînent sans problème, ce qui permet d'économiser le coût des séances photo réelles.

Jouer avec Pika m’a donné une sensation similaire à celle de jouer à « QQ Show » et « Les Sims », où nous décidons comment habiller les personnages de la vidéo.

Si vous voulez réaliser le « rêve » d’Elon Musk, c’est facile. Tout d’abord, utilisez d’autres outils d’IA pour générer un t-shirt « Conquer Mars » et un chapeau rouge avec « MAGA » écrit dessus.

Ensuite, téléchargez ces images, une scène de Mars, la photo de Musk, son robot humanoïde Optimus Prime et son prototype de mème Internet préféré Doge sur Pika.

À la fin, un jeune homme ensoleillé et joyeux apparaît, avec un chien à gauche et un robot à droite, l'air amical mais pas tout à fait comme Musk.

Qu'il lui ressemble ou non est une chose, tant que vous gardez l'esprit ouvert, les possibilités sont infinies. En utilisant des photos de nous-mêmes et de célébrités, nous pouvons facilement nous engager dans le fandom. Téléchargez des chapeaux, des vêtements et des instruments pour nous habiller de la tête aux pieds. Rassemblez des scènes, des produits et des modèles, et vous obtenez une simple vidéo commerciale…

Les photos + images IA + Pika 2.0 + invites peuvent générer de nombreux visuels intéressants. Cette méthode évite également certains des défauts des modèles vidéo, comme l'écriture, qui peuvent être résolus avec des modèles d'images. Sans concurrencer directement les capacités de modélisation de Google ou se comparer aux rêves hollywoodiens de Runway, Pika a son approche unique.

Pika a toujours été un maître de la créativité, avec sa précédente série de fonctionnalités d'effets spéciaux d'IA, Pikaffect, devenue virale sur des plateformes comme RedNote et TikTok, poussant la base d'utilisateurs de Pika à plus de 11 millions.

Pika a su attirer un groupe d'utilisateurs très demandeurs de vidéos courtes et divertissantes. Même si ces vidéos sont basées sur des modèles et sont éphémères, tant qu'elles sont amusantes, les gens afflueront vers elles.

Qui a dit que pour gagner, il fallait tout rafler ? Le marché de l'IA est vaste, et si simuler le monde physique est un rêve grandiose, atteindre le petit objectif de créer de courtes vidéos d'IA amusantes est également une forme de réussite.

Source à partir de si un

Avis de non-responsabilité : les informations présentées ci-dessus sont fournies par ifanr.com, indépendamment d'Chovm.com. Chovm.com ne fait aucune représentation ni garantie quant à la qualité et à la fiabilité du vendeur et des produits. Chovm.com décline expressément toute responsabilité en cas de violations des droits d'auteur du contenu.